Local LLM Notepadは、オープンソースのオフラインアプリケーションで、インターネットに接続することなく、インストールすることなく、USBデバイスを介して、Windowsコンピュータ上でLocal Large Language Modelsを実行することができます。ユーザーは、単一の実行ファイル(EXE)とモデルファイル(GGUF形式など)をUSBスティックにコピーするだけです...

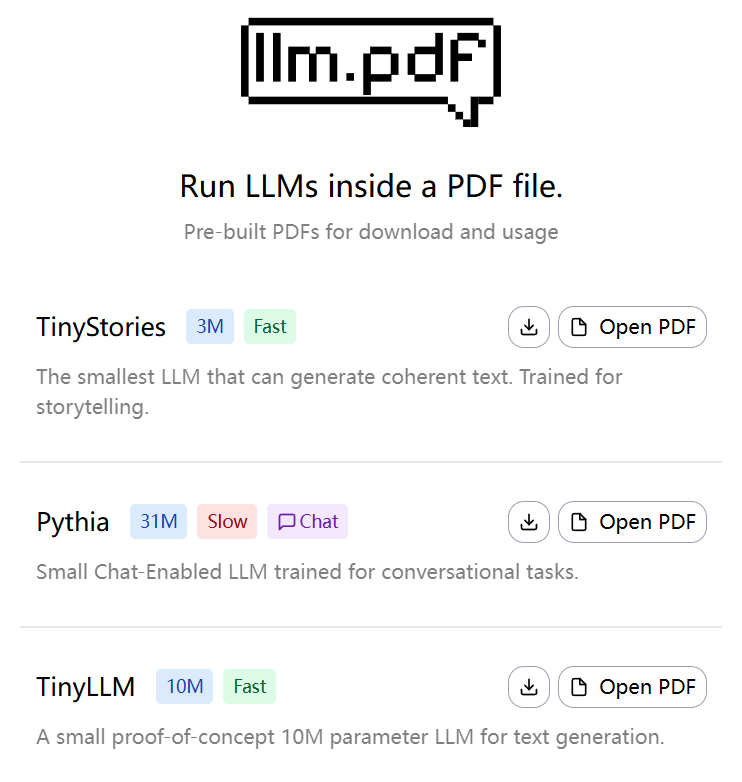

llm.pdfはLarge Language Models (LLM)をPDFファイルで直接実行できるオープンソースプロジェクトです。EvanZhouDevによって開発され、GitHubでホストされているこのプロジェクトは、Emscriptenを介してllama.cppをコンパイルするという革新的なアプローチを示しています。

Aana SDKはMobius Labsによって開発されたオープンソースのフレームワークで、マラヤーラム語のആന(象)にちなんで名付けられました。Aana SDKは、Ray Distributed Computing Frameworkをベースにしています。

BrowserAIは、ユーザーがブラウザ上でネイティブAIモデルを直接実行できるオープンソースツールである。Cloud-Code-AIチームによって開発され、Llama、DeepSeek、Kokoroなどの言語モデルをサポートしている。ユーザーは、サーバーや複雑なセットアップなしで、ブラウザからテキスト生成を行うことができる。

LitServeは、Lightning AIが提供するオープンソースのAIモデルサービスエンジンであり、FastAPI上に構築され、汎用AIモデル向けの推論サービスを迅速に展開することに重点を置いている。大規模言語モデル(LLM)、視覚モデル、音声モデルから古典的な機械学習モデルまで、幅広いシナリオをサポートし、バッチ...

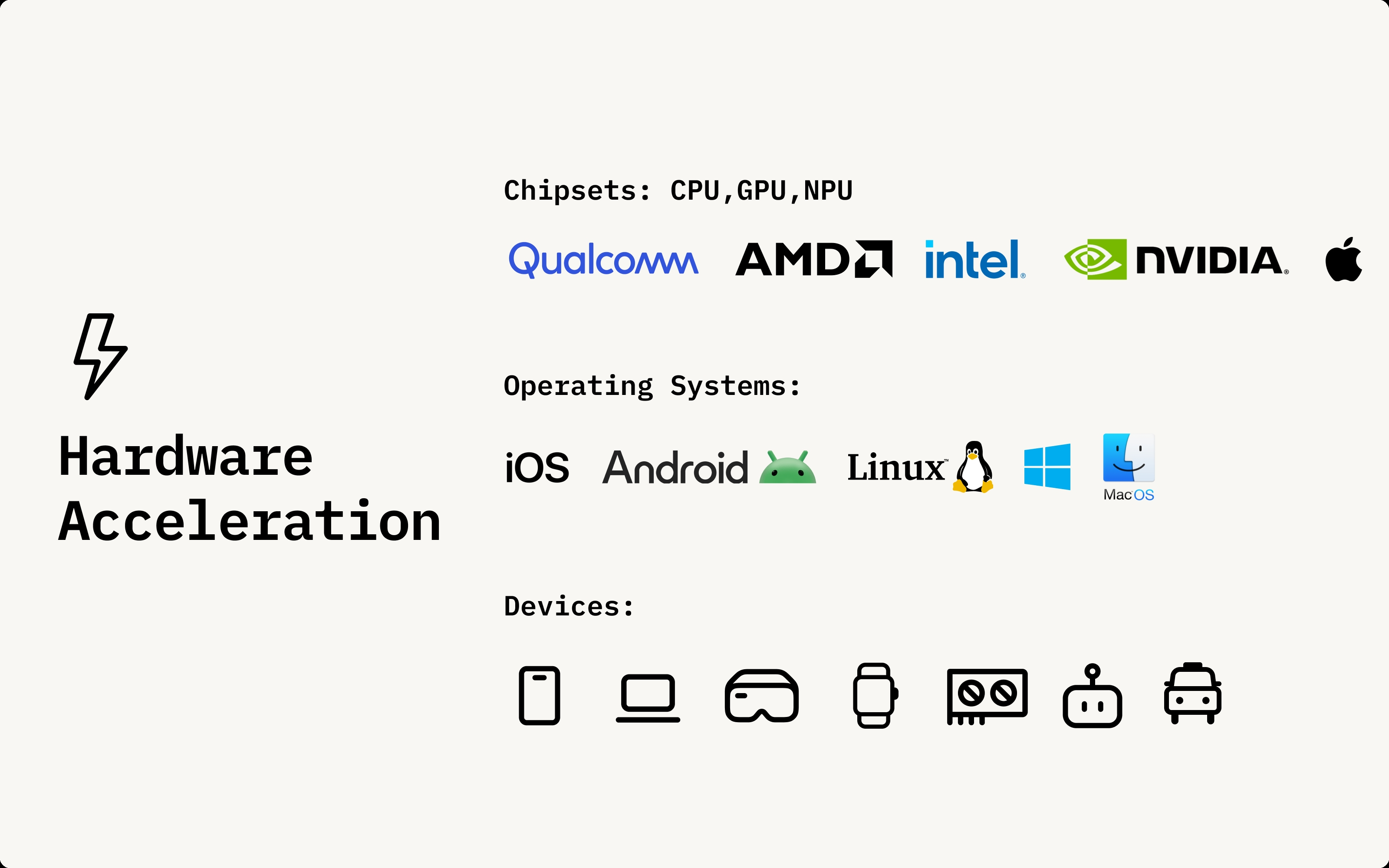

Nexa AIは、ローカルで動作するマルチモーダルAIソリューションに特化したプラットフォームである。自然言語処理(NLP)、コンピュータ・ビジョン、音声認識・生成(ASRとTTS)を含む幅広いAIモデルを提供し、そのすべてをクラウド・サービスに依存することなくローカル・デバイス上で実行することができる。この ...

vLLMは、Large Language Modelling (LLM)のために設計された、高スループットでメモリ効率の良い推論・サービスエンジンである。vLLMの目的は、高速で簡単な推論を提供することである。

Transformers.jsはHugging Faceが提供するJavaScriptライブラリで、最先端の機械学習モデルをサーバーのサポートなしにブラウザ上で直接実行できるように設計されている。このライブラリはHugging FaceのPython版トランスフォーマーと互換性があります。

Harborは、コンテナ化された革新的なLLMツールセットで、ローカルAI開発環境のデプロイと管理を簡素化することに重点を置いています。開発者は、クリーンなコマンドラインインターフェイス(CLI)とコンパニオンアプリケーションを使用して、ワンクリックでLLMバックエンド、APIインターフェイス、フロントエンドインターフェイスを含むすべてのAIサービスコンポーネントを起動し、管理することができます。

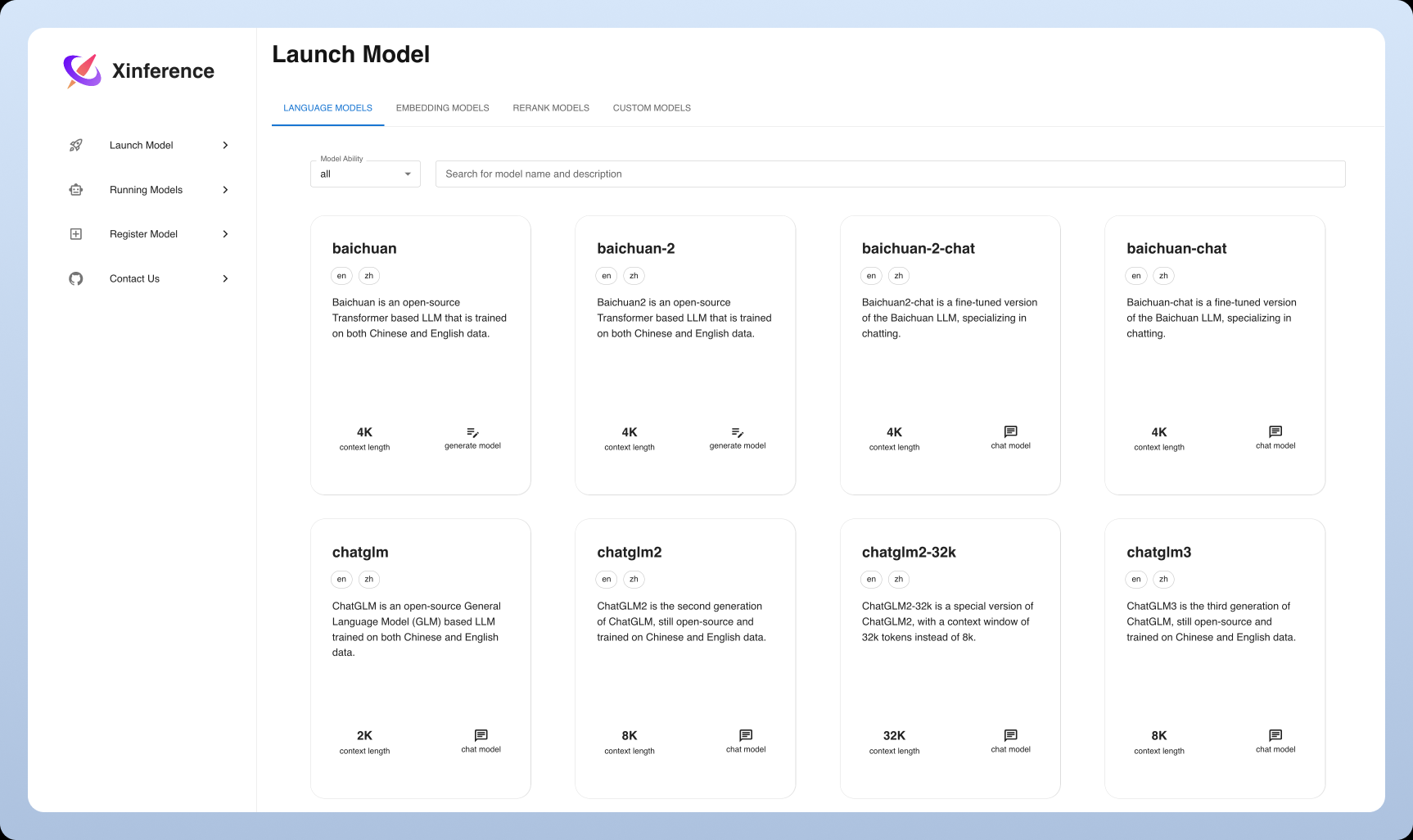

Xorbits Inference(略してXinference)は、言語モデル、音声認識モデル、マルチモーダルモデルの分散デプロイと配信に特化した、強力で汎用性の高いライブラリです。Xorbits Inferenceを使用すると、ユーザーは独自のモデルやビルトインの高度なモデルを簡単にデプロイして提供することができます。

AI Dev Galleryは、Windows開発者向けに設計されたマイクロソフトのAI開発ツールアプリ(現在パブリックプレビュー中)です。開発者がAI機能をWindowsアプリケーションに簡単に統合するための包括的なプラットフォームを提供する。このツールの最大の特長は、AI機能をWindowsアプリケーションに統合するための包括的なプラットフォームを提供することである。

LightLLMはPythonベースのLarge Language Model(LLM)推論・サービスフレームワークで、軽量設計、拡張の容易さ、効率的なパフォーマンスで知られている。このフレームワークは、FasterTransformer、TGI、vLLM、FlashAtten...などの有名なオープンソースの実装を活用しています。

Transformers.jsは、Hugging Face社によって開発されたJavaScriptライブラリで、最先端の機械学習モデルをサーバーのサポートなしにブラウザ上で直接実行することを可能にする。このライブラリはHugging FaceのPython Transformers.jsと互換性があります。

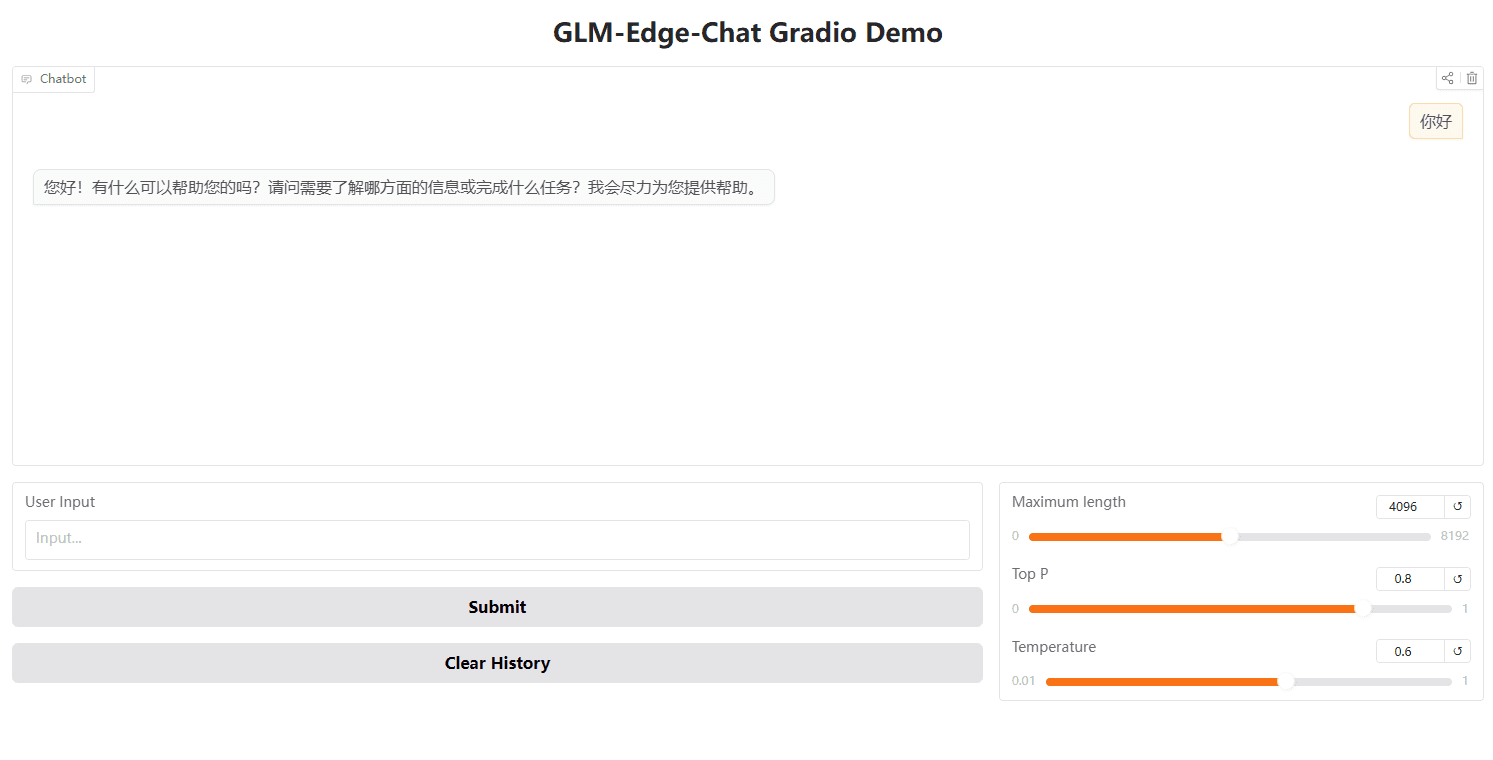

GLM-Edgeは、清華大学(Smart Spectrum Light Language)のエンドサイドデバイス用に設計された大規模言語モデルとマルチモーダル理解モデルのシリーズです。これらのモデルには、GLM-Edge-1.5B-Chat、GLM-Edge-4B-Chat、GLM-Edge-V-2B、GLM-Edge-V-5...が含まれます。

Exoは、身近なデバイス(iPhone、iPad、Android、Mac、Linuxなど)を使って独自のAIクラスターを実行することを目的としたオープンソースプロジェクトである。動的なモデル分割とデバイスの自動検出により、Exoは複数のデバイスを単一の強力なGPUに統合することができ、LLaMA、Mistral...などの複数のモデルをサポートしています。

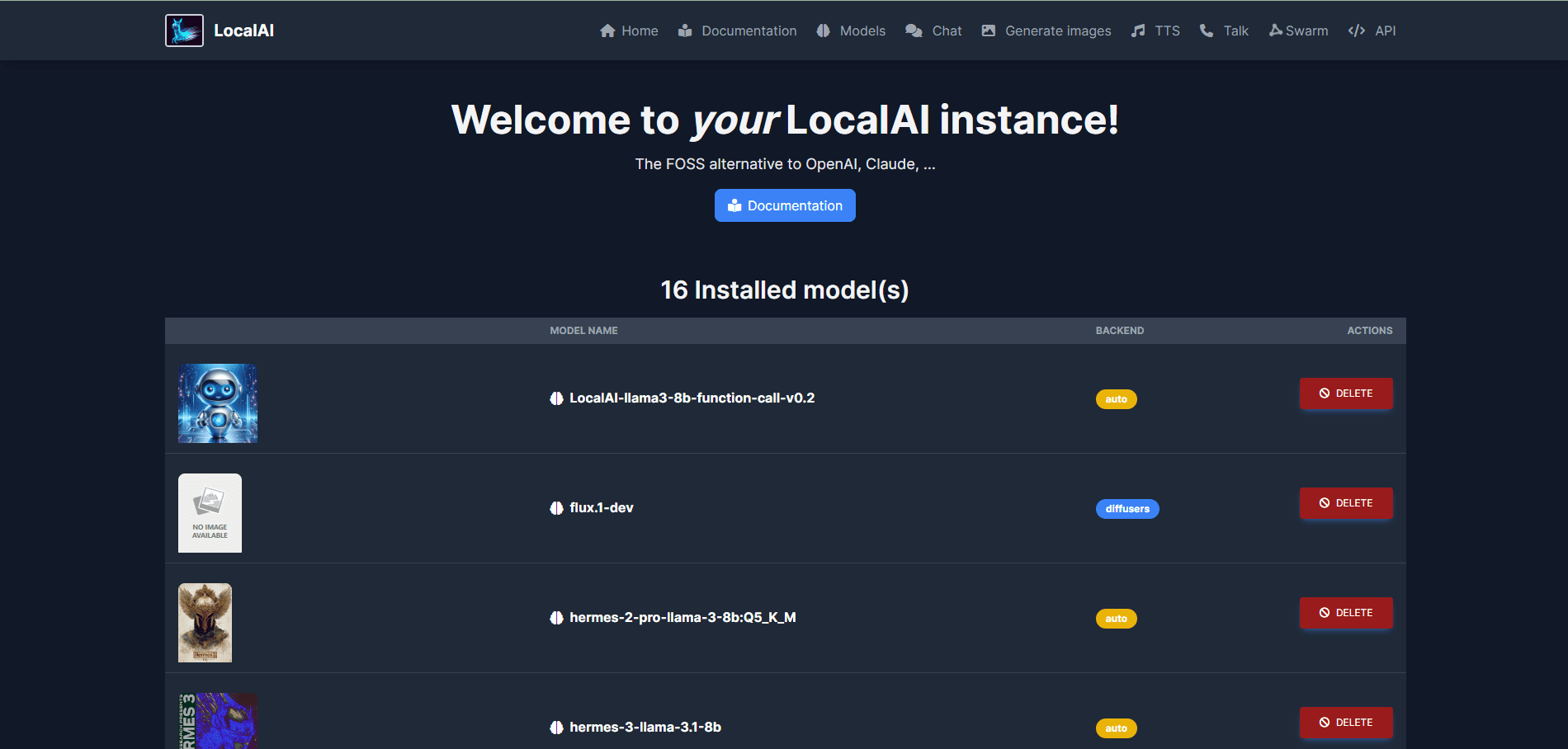

LocalAIは、OpenAIやClaudeなどと互換性のあるAPIインターフェースを提供することを目的とした、オープンソースのローカルAI代替ソフトウェアである。コンシューマーグレードのハードウェア上での実行をサポートし、GPUを必要とせず、テキスト、オーディオ、ビデオ、画像生成、スピーチクローンなどの幅広いタスクを実行することができる。

llamafileはMozilla Buildersプロジェクトのツールで、Large Language Model (LLM)のデプロイと運用を簡単にするために設計されています。llama.cppとCosmopolitan Libcを組み合わせることで、llamafileはLLMデプロイの複雑さを...

PetalsはBigScience Workshopによって開発されたオープンソースプロジェクトで、分散コンピューティングアプローチによって大規模言語モデル(LLM)を実行する。ユーザーは、コンシューマーグレードのGPUやGoogle Colabを使って、自宅でLLMを実行し、微調整することができる。

AphroditeエンジンはPygmalionAIの公式バックエンドエンジンで、PygmalionAIのウェブサイトに推論エンドポイントを提供し、Hugging Face互換モデルの迅速な展開をサポートするように設計されています。このエンジンはvLLMのページド・アテンション技術を活用し、効率的なK/...