| Axolotl |

Ein Rahmen für die Feinabstimmung von Sprachmodellen |

| Gemma |

Googles neueste Implementierung des Big Language Model |

– finetune-gemma.ipynb – gemma-sft.py – Gemma_finetuning_notebook.ipynb |

Feinabstimmung von Notizbüchern und Skripten |

| LLama2 |

Metas Open-Source-Modell für große Sprachen |

– generate_response_stream.py – Llama2_finetuning_notebook.ipynb – Llama_2_Fine_Tuning_using_QLora.ipynb |

Leitlinien für die Umsetzung und Feinabstimmung |

| Llama3 |

Kommende Experimente mit Meta Large Language Modelling |

– Llama3_finetuning_notebook.ipynb |

Erste Versuche zur Feinabstimmung |

| LlamaFactory |

Ein Rahmen für das Training und den Einsatz großer Sprachmodelle |

| LLMArchitektur/ParameterZahl |

Technische Details der Modellarchitektur |

| Mistral-7b |

Mistral AI Das Modell mit 7 Milliarden Parametern |

– LLM_evaluation_harness_for_Arc_Easy_and_SST.ipynb – Mistral_Colab_Finetune_ipynb_Colab_Final.ipynb – notebooks_chatml_inference.ipynb – notebooks_DPO_fine_tuning.ipynb – notebooks_SFTTrainer TRL.ipynb – SFT.py |

Integriertes Notizbuch für Bewertung, Feinabstimmung und Argumentation |

| Mixtral |

Mixtrals Modell der Expertenmischung |

– Mixtral_fine_tuning.ipynb |

Feinabstimmung der Umsetzung |

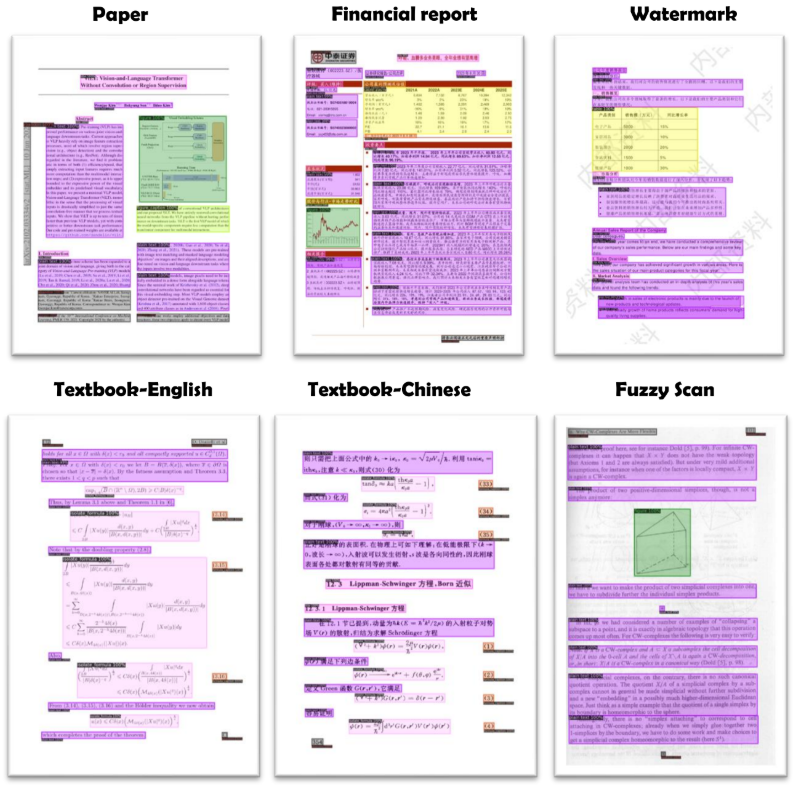

| VLM |

visuelles Sprachmodell |

– Florence2_finetuning_notebook.ipynb – PaliGemma_finetuning_notebook.ipynb |

Implementierung des visuellen Sprachmodells |